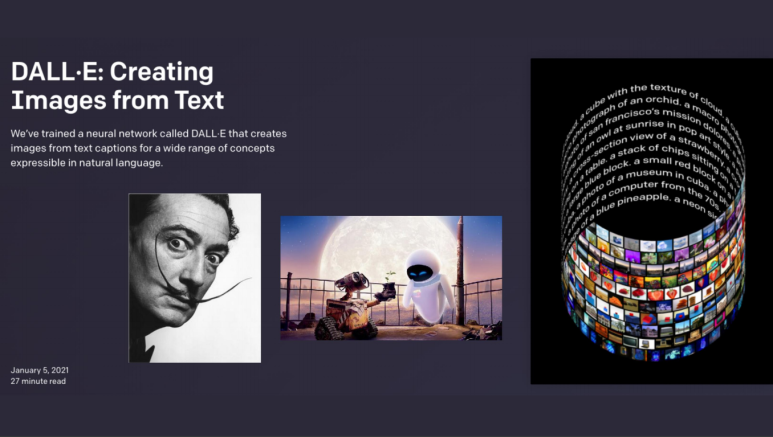

| From 2021 to 2022 2021 2021 Ramesh et al., “Zero-Shot Text-to-Image Generation (DALL-E),” ICML’21 2021년 1월 5일. 엄청나게 큰 모델과, 엄청나게 큰 Data. 거기에다가 이 둘을 잘 처리할 수 있는 엄청나게 좋은 연산 컴퓨터가 있다면 겁나게 좋은 성능의 이미지 생성 모델을 얻을 수 있다는 것을 발표했다. ( 사실 그 당시 가장 좋은 성능을 뽑아내는 V100 GPU를 가지고도 DALL-E 모델 한개 조차 들어가지 못할 정도로 큰 모델을 사용하였다. 이를 처리하기 위한 다양한 분산 처리 기술들을 활용하였다.(여러개의 GPU에 따로따로 분산학습 시킨다음 합치는 방식) ) DALL-E는 12B(120억)개의 par..